El último generador de vídeo con IA de Google reproduce situaciones inverosímiles para animales simpáticos

El martes, Google anunció Lumièreun generador de video de IA que llama «un modelo de difusión espacio-temporal para la generación de video realista» en Viene con papel preimpreso. Pero no nos engañemos: hace un gran trabajo creando vídeos de simpáticos animales en escenarios ridículos, como patinar, conducir un coche o tocar el piano. Por supuesto, puede hacer más, pero es quizás el generador de vídeo con IA de texto a animal más avanzado jamás demostrado.

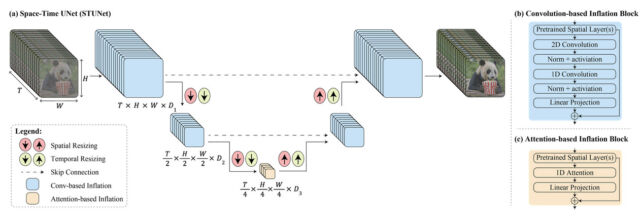

Según Google, Lumiere utiliza una arquitectura única para generar la duración temporal completa de un vídeo a la vez. O, como lo expresó la compañía, «Hemos introducido una arquitectura U-Net Espacio-Tiempo que genera la duración temporal completa del video a la vez, a través de un solo paso a través del modelo. Esto contrasta con los modelos de video existentes que sintetizan imágenes distantes fotogramas clave seguidos de superresolución temporal, un enfoque que inherentemente dificulta lograr una coherencia temporal global».

En términos simples, la tecnología de Google está diseñada para manejar simultáneamente aspectos del espacio (dónde están las cosas en el video) y del tiempo (cómo se mueven y cambian las cosas a lo largo del video). Entonces, en lugar de crear un video juntando muchas partes o fotogramas pequeños, puede crear el video completo, de principio a fin, en un proceso fluido.

El vídeo promocional oficial que acompaña al artículo «Lumiere: A Space-Time Diffusion Model for Video Generation» publicado por Google.

Lumiere también puede hacer muchos trucos de fiesta, que están muy bien presentados con ejemplos en Página de demostración de Google. Por ejemplo, puede generar texto a video (convertir un mensaje escrito en un video), convertir imágenes fijas en videos, generar videos en estilos específicos usando una imagen de referencia, aplicar una edición de video consistente usando mensajes basados en texto, crear cinemagrafías animar regiones específicas de una imagen y ofrecer vídeo pintura interna capacidades (por ejemplo, puede cambiar el tipo de vestimenta que lleva una persona).

En el artículo de investigación de Lumiere, los investigadores de Google afirman que el modelo de IA produce vídeos de cinco segundos de 1024×1024 píxeles, que describen como de “baja resolución”. A pesar de estas limitaciones, los investigadores realizaron un estudio de usuarios y afirman que los resultados de Lumiere fueron preferidos a los modelos de síntesis de vídeo con IA existentes.

En cuanto a los datos de entrenamiento, Google no dice de dónde obtuvo los videos que introdujeron en Lumiere y escribe: «Entrenamos nuestro T2V [text to video] modelo en un conjunto de datos que contiene 30 millones de videos junto con su título de texto. [sic] Los vídeos tienen 80 fotogramas a 16 fps (5 segundos). El modelo base está entrenado a 128×128”.

El vídeo generado por IA todavía se encuentra en un estado primitivo, pero su calidad ha mejorado en los últimos años. En octubre de 2022, cubrimos el primer modelo de síntesis de imágenes revelado públicamente por Google, Imagen Video. Podía generar videoclips cortos de 1280×768 a partir de un mensaje escrito a 24 cuadros por segundo, pero los resultados no siempre fueron coherentes. Antes de eso, Meta lanzó su generador de videos con IA, Make-A-Video. En junio pasado, el modelo de síntesis de video Gen2 de Runway permitió la creación de videoclips de dos segundos a partir de instrucciones de texto, impulsando la creación de comerciales de parodia surrealistas. Y en noviembre cubrimos Stable Video Diffusion, que puede generar clips cortos a partir de imágenes fijas.

Las empresas de inteligencia artificial suelen hacer demostraciones de generadores de vídeo con animales simpáticos, porque actualmente es difícil generar seres humanos coherentes y no deformados, sobre todo porque nosotros, como seres humanos (eres humano, ¿verdad?), somos expertos en notar cualquier defecto en el cuerpo humano. la forma en que se mueven. Basta con mirar a Will Smith, generado por IA, comiendo espaguetis.

A juzgar por los ejemplos de Google (y sin haberlos utilizado), Lumiere parece superar a estos otros modelos de generación de vídeo con IA. Pero dado que Google tiende a mantener bajo control sus modelos de investigación de IA, no estamos seguros de cuándo, si es que alguna vez, el público tendrá la oportunidad de probarlo por sí mismo.

Como siempre, cada vez que vemos que los modelos de síntesis de texto a video se vuelven más capaces, no podemos evitar pensar en el implicaciones futuras a nuestra sociedad conectada a Internet, que se centra en compartir artefactos mediáticos, y a la presunción general de que el vídeo «realista» suele representar objetos reales en situaciones reales captadas por una cámara. Las futuras herramientas de síntesis de vídeo, más capaces que Lumiere, harán que crear deepfakes engañosos sea trivialmente fácil.

Con ese fin, en la sección “Impacto social” del artículo de Lumiere, los investigadores escriben: “Nuestro principal objetivo en este trabajo es permitir a los usuarios novatos generar contenido visual de una manera creativa y flexible. [sic] Sin embargo, existe el riesgo de un uso indebido para crear contenido falso o dañino con nuestra tecnología, y creemos que es crucial desarrollar y aplicar herramientas para detectar sesgos y casos de uso maliciosos con el fin de garantizar un uso seguro y justo”.