El implante cerebral convierte los pensamientos en palabras para ayudar al paralítico a «hablar» de nuevo.

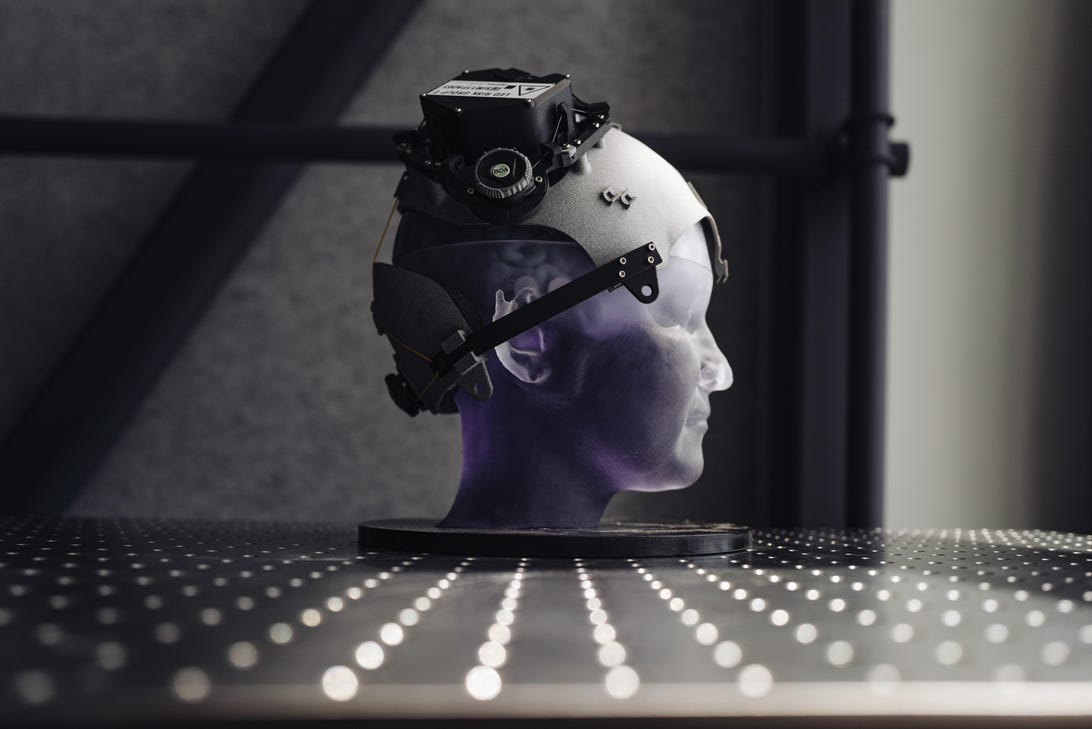

La interfaz cerebro-computadora de UCSF se aplica quirúrgicamente directamente a la corteza motora del paciente para permitir la comunicación.

Ken Probst, UCSF

El trabajo de Facebook sobre tecnología de entrada neuronal para RA y VR parece estar avanzando hacia un dirección más basada en pulsos, pero la compañía continúa invirtiendo en la investigación de interfaces cerebro-computadora implantadas. O ultima fase de un años Un estudio de la UCSF financiado por Facebook llamado Proyecto Steno traduce los intentos de conversación de un paciente paralizado y con problemas del habla en palabras en una pantalla.

«Esta es la primera vez que alguien que intenta decir palabras de forma natural puede decodificarse en palabras simplemente a partir de la actividad cerebral», dijo el Dr. David Moses, autor principal de un estudio publicado el miércoles en Revista de Medicina de Nueva Inglaterra. «Con suerte, esta es una prueba de principio para el control directo del habla desde un dispositivo de comunicación, utilizando el intento de hablar como una señal de control por alguien que no puede hablar, que está paralizado».

Las interfaces cerebro-computadora (BCI) están detrás de una serie de descubrimientos recientes prometedores, incluida la investigación de Stanford que puede transformar la escritura imaginaria en texto proyectado. El estudio de la UCSF adopta un enfoque diferente, analizando los intentos reales de hablar y actuando casi como un traductor.

El estudio, realizado por el neurocirujano de UCSF, el Dr. Edward Chang, implicó la implantación de una «neuroprótesis» de electrodos en un hombre paralítico que sufrió un derrame cerebral a los 20 años. Con un parche de electrodos implantado sobre el área del cerebro asociada con el control del tracto vocal, el hombre trató de responder a las preguntas que se mostraban en una pantalla. Los algoritmos de aprendizaje automático de UCSF pueden reconocer 50 palabras y convertirlas en oraciones en tiempo real. Por ejemplo, si el paciente vio un mensaje que preguntaba «¿Cómo estás hoy?» la respuesta apareció en la pantalla como «Soy realmente bueno», apareciendo palabra por palabra.

Moses aclaró que el trabajo tendrá como objetivo continuar más allá de la fase de financiación de Facebook y que la investigación aún tiene mucho trabajo por hacer. Por el momento, no está claro cuánto del reconocimiento de voz proviene de patrones registrados de actividad cerebral, expresiones vocales o una combinación de ambos.

Moses se apresura a señalar que el estudio, al igual que otros trabajos de BCI, no es una lectura de la mente: se basa en detectar la actividad cerebral que ocurre específicamente cuando se intenta participar en un comportamiento en particular, como hablar. Moses también dice que el trabajo del equipo de UCSF todavía no se traduce en interfaces neuronales no invasivas. Neuralink de Elon Musk promete la transmisión inalámbrica de datos desde electrodos implantados en el cerebro para futuras investigaciones y usos de asistencia, pero hasta ahora esta tecnología solo se ha demostrado. en un mono.

El prototipo de dispositivo de casco BCI de Facebook Reality Labs, que no tenía electrodos implantados, se está convirtiendo en código abierto.

Facebook

Mientras tanto, Facebook Reality Labs Research se ha alejado de las interfaces cerebro-computadora utilizadas en la cabeza para futuros auriculares VR / AR, mirando hacia el futuro cercano para enfocarse en dispositivos usados en la muñeca basado en la tecnología adquirido de CTRL-Labs. Facebook Reality Labs tenía sus propios auriculares de investigación de casco prototipo no invasivos para estudiar la actividad cerebral, y la compañía anunció que planea ponerlos a disposición para proyectos de investigación de código abierto, ya que ya no se enfoca en el hardware de la cabeza neuronal. (UCSF recibe fondos de Facebook, pero no de hardware).

«Los aspectos del trabajo montado en el cabezal óptico serán aplicables a nuestra investigación EMG de muñeca. Continuaremos utilizando BCI óptico como una herramienta de investigación para construir mejores modelos y algoritmos de sensores basados en la muñeca. En la investigación, ya no estamos desarrollando un cabezal dispositivo BCI óptico montado para detectar la producción de voz, que es una de las razones por las que compartiremos nuestros prototipos de hardware montados en la cabeza con otros investigadores, que pueden aplicar nuestra innovación a otros casos de uso «, confirmó un representante de Facebook por correo electrónico.

La tecnología de entrada neuronal impulsada por el consumidor todavía en tu infancia, Aún. Si bien hay dispositivos de consumo que utilizan sensores no invasivos en la cabeza o la muñeca, son mucho menos precisos que los electrodos implantados actualmente.